Dos nuevos experimentos muestran que la mayoría de las personas ni siquiera consideran que la inteligencia artificial pueda generar un mensaje personal, incluso cuando usan la IA para escribirlo ellos mismos.

Una disculpa ficticia generada por IA enviada por mensaje de texto fue uno de los mensajes que los participantes evaluaron en un estudio reciente. Zhu y Molnar (2026)

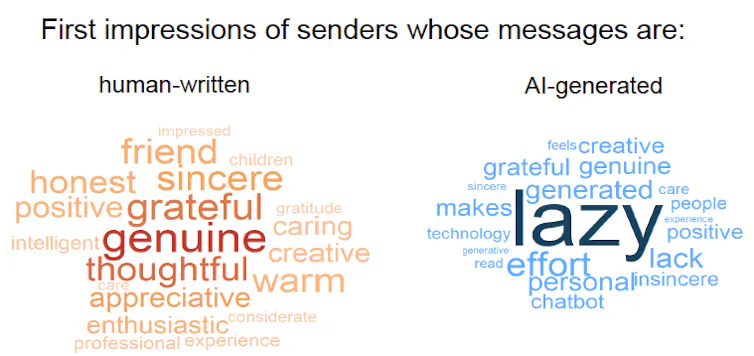

Encontramos una clara “penalización por detección de IA”. Cuando las personas sabían que el mensaje había sido generado por inteligencia artificial, calificaban al remitente mucho más negativamente – “vago”, “falto de sinceridad”, “falta de esfuerzo” – que cuando creían que el mismo texto había sido escrito por una persona – “genuino”, “agradecido”, “reflexivo”.

Pero aquí está el giro: los participantes a quienes no se les dijo nada sobre la autoría obtuvieron impresiones que fueron tan positivas como las de las personas a las que se les dijo que los mensajes eran realmente humanos.

Esta total falta de escepticismo nos sorprendió y plantea nuevas preguntas. Quizás los participantes no estaban lo suficientemente familiarizados con la IA como para darse cuenta de que los modelos actuales pueden producir mensajes detallados y personales. (Pueden). O tal vez los participantes nunca hayan usado IA. (Probablemente lo hicieron). Así que también probamos si el uso de la IA por parte de los participantes cambió la forma en que juzgaban a los remitentes.

Para nuestra sorpresa aún mayor, observamos poco o ningún efecto. Las personas que utilizan la IA generativa con bastante frecuencia en su vida diaria (al menos cada dos días) penalizaron ligeramente menos el uso de la IA cuando se reveló la autoría de la IA, en comparación con las personas que nunca o rara vez usan la IA. Pero los participantes no eran más escépticos por defecto: cuando no se reveló la autoría, los usuarios intensivos de IA, los usuarios ligeros de IA y los no usuarios asumieron que el texto fue escrito por una persona y se formaron esencialmente las mismas impresiones.

Las nubes de palabras muestran las primeras impresiones de los participantes sobre los remitentes que escribieron ellos mismos los mensajes, a la izquierda, y los que utilizaron inteligencia artificial, a la derecha. Andraš Molnar ¿Por qué es importante?

La falta de escepticismo y de impresiones negativas son importantes porque las personas hacen juicios sociales basados en textos todo el tiempo. Los destinatarios consideran que tomarse el tiempo y el esfuerzo de enviar mensajes escritos es una idea de la sinceridad, autenticidad o competencia del escritor, y esas impresiones dan forma a la amistad, las citas y las decisiones comerciales de las personas.

Sin embargo, nuestros principales hallazgos revelan una sorprendente desconexión: las personas generalmente no sospechan que están usando IA a menos que sea obvio. Este desconocimiento crea un dilema moral: las personas que utilizan la inteligencia artificial en secreto pueden disfrutar de los beneficios casi sin riesgo de ser detectadas. Mientras tanto, paradójicamente, las personas que son abiertas y admiten el uso de inteligencia artificial sufren en su reputación.

Con el tiempo, la falta de escepticismo y conciencia podría remodelar lo que significa la escritura en la vida cotidiana. Los lectores podrían aprender a tratar la escritura como una señal menos confiable del carácter o el esfuerzo de uno y, en cambio, confiar en otras formas de comunicación. Por ejemplo, el uso generalizado de la inteligencia artificial ya ha llevado a los empleadores a reducir el valor de las cartas de presentación de los solicitantes de empleo. En cambio, dependen más de las recomendaciones personales del supervisor actual del candidato o de las conexiones realizadas a través de redes personales.

¿Qué otras investigaciones se están realizando?

Otros investigadores han documentado una amplia gama de impresiones negativas de personas que revelan su uso de inteligencia artificial. Los estudios demuestran que hace que los solicitantes de empleo parezcan menos deseables y los empleados menos competentes. Los lectores de escritura creativa ven a los usuarios de IA como menos creativos y menos auténticos. La gente considera que las disculpas personales y corporativas basadas en IA son menos efectivas. En general, la divulgación del uso de inteligencia artificial reduce la confianza y socava la legitimidad.

Sin embargo, sin divulgación, existe evidencia clara de que la mayoría de las personas no pueden detectar de manera confiable el texto generado por IA, incluso con herramientas de detección, especialmente cuando el texto es una mezcla de contenido escrito por humanos y generado por IA. Incluso cuando los humanos confían en su capacidad para detectar textos de IA, su confianza puede no ser más que una ilusión de autoconfirmación.

¿Qué sigue?

Aunque nuestros experimentos no revelaron dudas sobre el uso de la inteligencia artificial, esto no significa que la gente nunca dude de ello en el mundo real. En algunos entornos, es posible que las personas ya estén muy atentas a la IA. El uso en el mundo académico es un ejemplo obvio. En nuestros próximos estudios, queremos entender cuándo y por qué la gente empieza naturalmente a dudar del uso de la inteligencia artificial y qué es lo que mueve el interruptor entre la confianza y la duda.

El Research Brief es una breve descripción de trabajos académicos interesantes.

Descubre más desde USA TODAY NEWS INDEPENDENT PRESS US

Suscríbete y recibe las últimas entradas en tu correo electrónico.