En las principales plataformas, los mensajes de odio se multiplican a medida que los algoritmos recompensan el contenido más emotivo y polarizador. De hecho, la creciente tensión política ha desencadenado estos ataques en las redes sociales.

La mayoría de las investigaciones hasta la fecha se han centrado en contar cuántos mensajes de odio aparecen en momentos de tensión, como una pandemia o determinadas elecciones. Sin embargo, apenas se ha estudiado por qué tantas logran superar los filtros y permanecen visibles durante años. Estos mensajes quedan como “nodos latentes” que pueden reactivarse en cada nueva crisis.

El ecosistema digital difunde odio, impulsado por los me gusta y los retuits más que por su verdad o valor ético. El resultado es una erosión lenta pero profunda de la democracia y la coexistencia pacífica.

Varios investigadores de Hatemedia realizaron un estudio mediante el cual pretendíamos descubrir si el odio en español se ha eliminado de la red X y, en su caso, los motivos por los que esto ocurre.

Para comprender mejor el contexto, es útil considerar los experimentos de Stratcom (Centro de Excelencia en Comunicaciones Estratégicas de la OTAN), que se llevan a cabo desde 2021, ya que éste se realizó en 2025.

Con sólo 252 euros se compraron interacciones para difundir miles de mensajes de desinformación y odio para medir su alcance y durabilidad. Tras cuatro semanas en las redes, más del 84% de los mensajes de TikTok fueron seguidos, el 99% en Vkontakte, el 43,41% en X o el 84,03% en Instagram.

Cómo construimos el análisis

En el estudio realizado, partimos de 2,1 millones de mensajes en Nuestro experimento se basa en el seguimiento de 9.894 mensajes de odio, recopilados durante el periodo mencionado, durante noviembre y diciembre de 2024. Estos mensajes se clasificaron en cuatro intensidades y varios tipos.

El objetivo era descubrir cuánto odio persiste en X y qué factores influyeron en su eliminación.

Metodología del estudio. Imagen proporcionada por los autores., CC BI-NC Hallazgos que desafían los supuestos

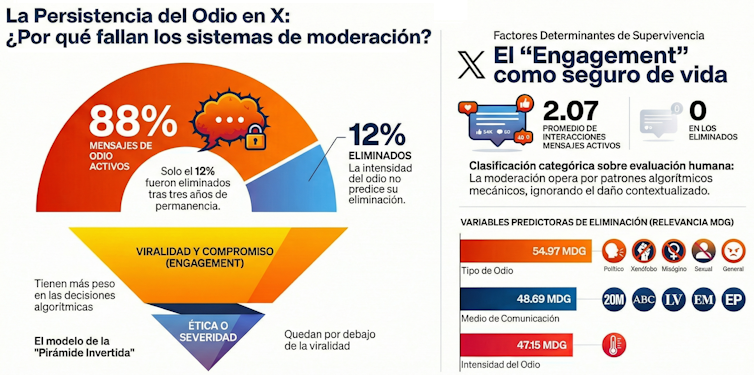

Los resultados obtenidos nos mostraron que sólo el 12% de los mensajes de odio (1.170) fueron eliminados. El 88% restante (8.724) todavía eran visibles a los 2-3 años.

También observamos cómo la intensidad del mensaje apenas afecta a su supervivencia. Las amenazas más graves de nivel 4 se eliminaron incluso menos (11,54%) que los comentarios groseros de nivel 1 (12,11%).

Lo que más pesó en la eliminación fue el tipo de odio: se eliminaron más mensajes de odio general (12,54%), misógino (11,97%), sexual (11,14%) y xenófobo (11,10%) que políticos (10,96%).

También observamos diferencias según el medio. Los comentarios de odio recogidos en medios como ABC y La Vanguardia fueron los más eliminados (entre un 14% y un 15%), mientras que los vinculados a 20 Minutos fueron los menos frecuentes (9%).

La persistencia del odio en Ks. Imagen proporcionada por los autores., CC BI-NC

Los mensajes que permanecieron activos tuvieron más interacciones y mostraron emociones más intensas, como la ira. Por lo tanto, es más probable que los mensajes más virales, emocionales y políticamente conectados sigan presentes en X.

El hecho de que estos mensajes permanezcan en las redes los convierte en “durmientes”, listos para volver a ser utilizados de vez en cuando en protestas, campañas o elecciones. Con ello se pretende normalizar prejuicios y estereotipos. Mientras tanto, los emisores de estos mensajes aprovechan el actual contexto de comunicación digital. Se trata de un escenario donde el silencio de algunos usuarios por miedo a ser atacados favorece el empobrecimiento del debate público, lo que debilita la democracia.

Avanzamos hacia mejores estrategias

Estos datos nos ayudan a mostrar cómo lo viral y lo emocional prevalecen sobre cualquier otro aspecto. Ni siquiera parece importar la intensidad, aunque sea amenazante, para eliminarlos.

Estamos, por tanto, ante una puerta abierta a una manipulación -que además es muy barata- que perdura en el tiempo (88% al cabo de tres años).

El presidente francés, Emmanuel Macron, tenía razón cuando expresó en la cumbre de inteligencia artificial celebrada en Nueva Delhi en febrero pasado que la libertad de expresión en línea podría ser “basura” si no hay total transparencia algorítmica cuando se priorizan las interacciones tóxicas sobre la verdad y la democracia. En otras palabras: la libertad sin responsabilidad es imposible.

El desafío central es siempre el mismo: evitar que quienes mienten o dañan acaben limitando la libertad de expresión de quienes critican razonadamente. Los filtros son necesarios, pero pueden ser peligrosos si se aplican incorrectamente.

Como mínimo, es crucial que se elimine el odio que ya ha sido revelado y confirmado. Para lograrlo es necesario promover sistemas híbridos de moderación. Es decir, son capaces de combinar la gestión humana con el apoyo de la inteligencia artificial. Y eso, especialmente, en el encuentro con el odio más sutil: el de intensidad débil (que no es ofensivo ni amenazante, sino descortés o malicioso). Son mensajes que poco a poco conducen a la polarización social.

Los medios de comunicación también juegan un papel clave. Estos actores necesitan buenos protocolos editoriales, advertencias preventivas contra la desinformación y contranarrativas basadas en la empatía. Y, por parte del usuario, se necesita una educación digital que fomente el pensamiento crítico y compare la información con fuentes confiables.

Nuestro estudio muestra que el odio persiste porque el sistema actual lo hace rentable. Su cambio no depende sólo de mejores marcos legales o un mejor algoritmo. También es necesario tomar decisiones colectivas adecuadas. Por ejemplo, priorizan la dignidad y la ética sobre el desempeño del contenido. Si no lo hacemos, los mensajes “latentes” seguirán marcando la agenda del debate público.

Descubre más desde USA TODAY NEWS INDEPENDENT PRESS US

Suscríbete y recibe las últimas entradas en tu correo electrónico.