Los documentos judiciales presentados esta semana muestran que las empresas están finalizando acuerdos en demandas en las que las familias las acusaron de no implementar suficientes salvaguardias antes de lanzar públicamente los chatbots de IA. Familias de varios estados, incluidos Colorado, Florida, Texas y Nueva York, demandaron a las empresas.

Character.AI se negó a comentar sobre los acuerdos. Google no respondió de inmediato a una solicitud de comentarios.

Los acuerdos son el último avance en lo que se ha convertido en un gran problema para las principales empresas de tecnología a medida que lanzan productos impulsados por inteligencia synthetic.

El año pasado, unos padres de California demandaron al fabricante de ChatGPT, OpenAI, después de que su hijo Adam Raine se suicidara. ChatGPT, alega la demanda, proporcionó información sobre métodos de suicidio, incluido el que usó el adolescente para suicidarse. OpenAI ha dicho que se toma en serio la seguridad y ha implementado nuevos controles parentales en .

Las demandas han provocado un mayor escrutinio por parte de los padres, defensores de la seguridad infantil y legisladores, incluso en California, que aprobaron nuevas leyes el año pasado destinadas a hacer que los chatbots sean más seguros. Los adolescentes utilizan cada vez más chatbots tanto en la escuela como en casa, pero algunos han contado algunos de sus pensamientos más oscuros sobre personajes virtuales.

«No podemos permitir que las empresas de inteligencia synthetic pongan en peligro las vidas de otros niños. Nos complace ver que estas familias, algunas de las cuales han sufrido la pérdida definitiva, reciben una pequeña medida de justicia», dijo en un comunicado Haley Hinkle, asesora política de Fairplay, una organización sin fines de lucro dedicada a ayudar a los niños. «Pero no debemos ver este acuerdo como un remaining. Apenas hemos comenzado a ver el daño que la IA causará a los niños si no se regula».

Una de las demandas más destacadas involucró a la madre de Florida, Megan García, quien demandó a Character.AI, así como a Google y su empresa matriz, Alphabet, en 2024 después de que su hijo de 14 años, Sewell Setzer III, se quitara la vida.

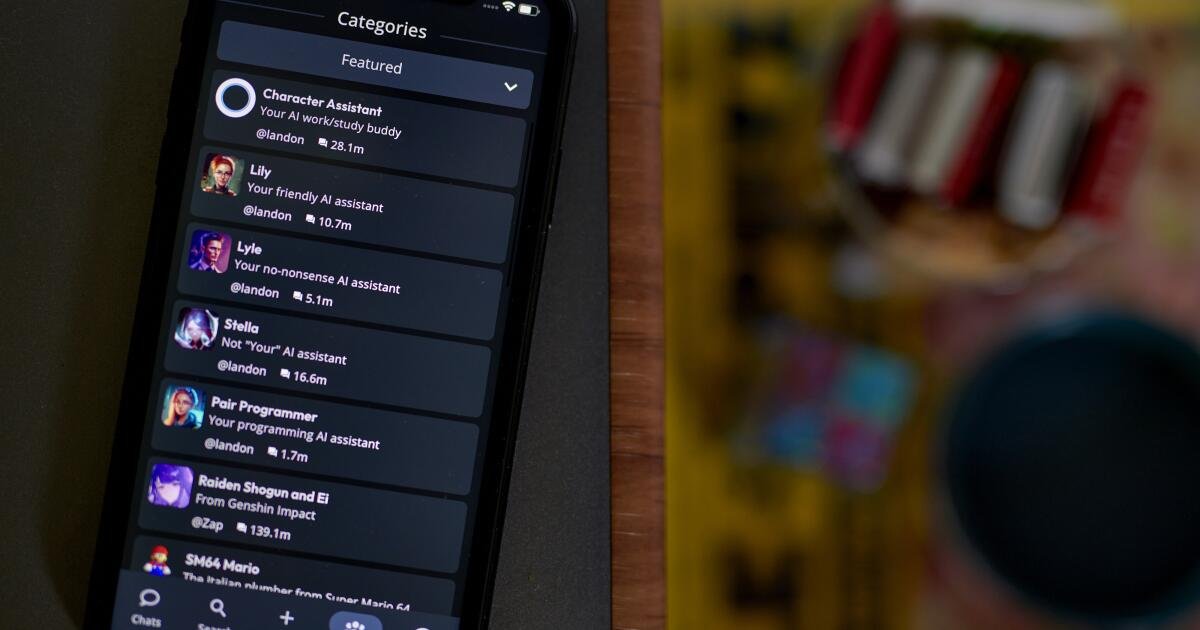

El adolescente comenzó a hablar con chatbots en Character.AI, donde las personas pueden crear personajes virtuales basados en personas reales o ficticias. Sintió como si se hubiera enamorado de un chatbot que lleva el nombre de Daenerys Targaryen, personaje principal de la serie de televisión «Juego de Tronos», según la demanda.

García alegó en la demanda que varios chatbots con los que hablaba su hijo dañaban su salud psychological y Character.AI no le notificó ni le ofreció ayuda cuando expresó pensamientos suicidas.

“Las Partes solicitan que este asunto se suspenda para que puedan redactar, finalizar y ejecutar documentos formales de conciliación”, según un aviso presentado el miércoles en un tribunal federal de Florida.

Los padres también demandaron a Google y su empresa matriz porque los fundadores de Character.AI, Noam Shazeer y Daniel De Freitas, tienen vínculos con el gigante de las búsquedas. Después de dejar y cofundar Character.AI en Menlo Park, California, ambos se reincorporaron a la unidad de IA de Google.

Google ha dicho anteriormente que Character.AI es una empresa independiente y que el gigante de las búsquedas nunca “tuvo un papel en el diseño o la gestión de su modelo o tecnologías de IA” ni los utilizó en sus productos.

Character.AI tiene más de 20 millones de usuarios activos mensuales. El año pasado, la compañía nombró a un nuevo director ejecutivo y dijo que prohibiría a los usuarios menores de 18 años tener conversaciones «abiertas» con sus chatbots y que está trabajando en una nueva experiencia para los jóvenes.

Descubre más desde Breaking News 24

Suscríbete y recibe las últimas entradas en tu correo electrónico.